Nieuwe bedreiging genaamd 'Skill Squatting' Ontdekt door UIUC

1 minuut gelezen

Amazon Echo

De wereld verandert en in het moderne tijdperk worden we met de dag afhankelijk van onze Internet of Things-apparaten. Maar deze afhankelijkheid kan ons alles kosten, het zou iemand in staat kunnen stellen onze identiteit, bankgegevens, medische geschiedenis en wat niet te stelen.

Amazon Alexa is bekritiseerd vanwege een aantal beveiligingsfouten, maar Amazon heeft er snel iets aan gedaan. Deze nieuwe beveiligingsfout heeft echter helemaal geen oplossing. En dit zou de gevaarlijkste beveiligingsdreiging tot nu toe kunnen zijn.

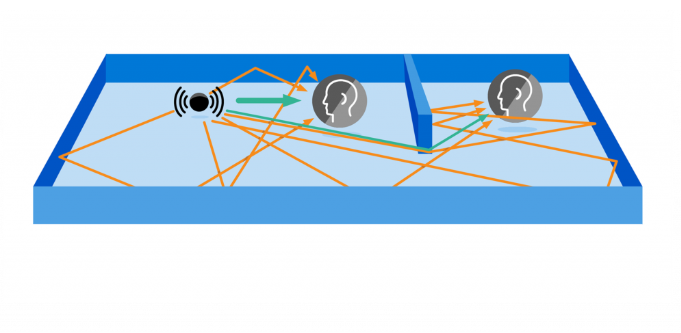

Volgens onderzoek uitgevoerd door de Universiteit van Illinois in Urbana-Champaign (UIUC), kunnen de eigenaardigheden van Amazon Alexa worden misbruikt door middel van spraakopdrachten om gebruikers naar kwaadaardige websites te leiden. Hackers richten zich op de mazen in machine learning-algoritmen om toegang te krijgen tot privé-informatie.

Een methode genaamd 'Skill squatting' is ontwikkeld door de onderzoekers van de University of Illinois in Urbana-Champaign en is een succesvolle methode om Amazon Alexa te misleiden om gebruikers naar kwaadaardige platforms te leiden met behulp van spraakopdrachten op Amazon Echo-apparaten.

Veel gebruikers spreken woorden vaak verkeerd uit, wat vaak resulteert in interpretatiefouten door Alexa, de spraakmotor die Amazon Echo aandrijft. Onderzoekers gebruikten 11.460 spraakvoorbeelden van de Engelse taalwoorden die door Amerikanen werden gesproken.

Vervolgens onderzochten ze waar Alexa spraakopdrachten verkeerd interpreteerde, hoe vaak het dit doet en waarom. Ze hebben kunnen ontdekken dat bepaalde verkeerde interpretaties regelmatig voorkomen.

Dus met behulp van 'Skill squatting' kan een hacker deze systematische fouten gebruiken om Amazon Echo-gebruikers naar kwaadaardige applicaties en websites te leiden en hun privégegevens op het spel te zetten. De methode kan worden gebruikt om bepaalde demografische gegevens te targeten, met name degenen die het Engels niet vloeiend spreken.

In een variant van de aanval die we speervaardigheidskraken noemen, laten we verder zien dat deze aanval gericht kan zijn op specifieke demografische groepen. We sluiten af met een bespreking van de veiligheidsimplicaties van spraakinterpretatiefouten, tegenmaatregelen en toekomstig werk.

Het probleem is misschien niet eenvoudig op te lossen, omdat het afhangt van de principes van machine learning waarop Alexa en andere AI-machines zijn gebouwd. Amazon beweert dat het maatregelen heeft getroffen om dit probleem tegen te gaan, maar onderzoek van de Universiteit van Illinois zegt iets anders.

Ze beweren dat dit geen gemakkelijke oplossing zal zijn en in de toekomst tot ernstige problemen zou leiden.

Tags Alexa Amazon